Grace Savides

Grace Savides is a Senior Research Analyst who loves discussing all things HR. She enjoys exploring where the theory, policies, and data-driven side of the industry interacts with the unpredictable and ever-important human elements. Before G2, she worked in content marketing, social media, health care, and editing. She dedicates her leisure time to video games, painting, DND, and spending time with her wonderful boyfriend and two dogs.

A seconda di chi chiedi, l'IA è la nostra salvezza, l'apocalisse, una novità, un cambiamento per l'industria o una moda passeggera. Tra assistenti virtuali per la scrittura, affrontare le barriere all'IA nel software della catena di approvvigionamento, e bot per la pianificazione delle riunioni, non c'è industria che non sia stata toccata dal bug del machine learning. Ma le risorse umane sono sempre state incentrate sulle persone. Quando l'"industria delle persone" viene automatizzata, le persone si innervosiscono.

In questo articolo, tratteremo come la tecnologia IA pervade le risorse umane, dove è già presente nel dipartimento, le preoccupazioni etiche e come possiamo affrontarle. Scorri fino alla sezione preferita o continua a leggere per l'intero viaggio mentre poniamo una domanda cruciale: come sta cambiando l'IA generativa il volto delle risorse umane e quali questioni etiche dovremmo prepararci ad affrontare man mano che questa tecnologia avanza?

Dove è presente l'IA nelle risorse umane?

L'IA è già presente nelle risorse umane, influenzando praticamente ogni categoria, dal marketing del reclutamento all'engagement dei dipendenti.

Chatbot, assistenti virtuali e automazione a ogni livello possono potenzialmente cambiare i lavori di reclutatori, amministratori e professionisti L&D. Scrivere e analizzare il linguaggio e il testo è una parte enorme delle risorse umane, e avere macchine che lo fanno al posto degli umani libera tempo e trasforma un processo che una volta era basato più sull'istinto in una semplice formula matematica. Come puoi vedere, l'IA nelle risorse umane ha un impatto di vasta portata.

Prima di espandere ulteriormente, cerchiamo di capire alcuni termini comuni associati all'IA.

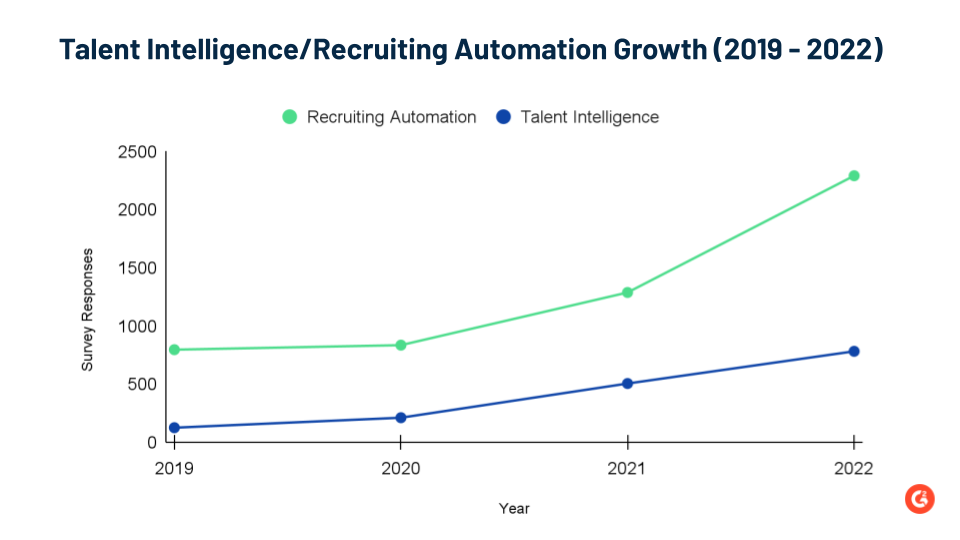

Attualmente non esiste una sezione in G2 che mappi l'IA nelle risorse umane. Tuttavia, ci sono due categorie in cui appare molto. La prima è la categoria Software di Talent Intelligence che definisce come l'IA rivoluziona la gestione e l'acquisizione dei talenti. La seconda è la categoria Software di Automazione del Reclutamento, che da tempo ha preso l'atto di reperire persone e automatizzare il processo.

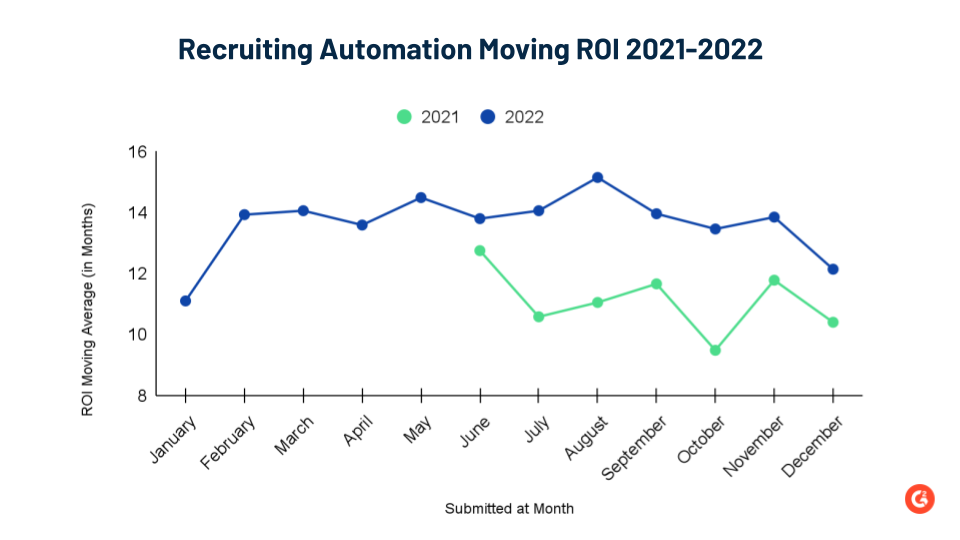

Entrambe le categorie hanno sperimentato una crescita esponenziale nel numero di recensioni, con l'Automazione del Reclutamento in aumento di circa il 188% e la Talent Intelligence in crescita di circa il 526% dalla creazione delle categorie G2 nel 2012. Questo è stato particolarmente vero tra il 2021 e il 2022.

Vediamo anche una forte presenza dell'IA nella categoria G2 Talent Intelligence. La Talent Intelligence è definita da soluzioni che utilizzano l'IA per migliorare il reperimento, l'abbinamento o la comprensione dei lavoratori e delle loro competenze. Abbiamo visto l'importanza di questo nella crescita marcata della categoria. La Talent Intelligence ha aggiunto così tanti prodotti negli ultimi 12 mesi che si trova nel top 24% delle categorie di tendenza di G2.

Man mano che approfondiamo come il machine learning rivoluziona le risorse umane, rivolgiamoci a qualcosa con cui internet (e l'IA) lottano: la sfumatura.

Analisi del testo e IA generativa nelle risorse umane

Qui, ci concentreremo sulle risorse umane e la loro connessione con l'IA generativa, cioè l'IA che può creare, scrivere, analizzare e affinare il testo. L'IA generativa produce nuovi contenuti—testi, immagini, ecc.—dopo essere stata addestrata su grandi set di dati.

Il modello di OpenAI ChatGPT ha dominato le notizie ultimamente, ma molteplici soluzioni di software di media sintetici offrono funzionalità simili, tra cui WriteSonic, Jasper e Anyword.

Leggi di più: Cos'è l'IA Generativa: Media Sintetici, LLM e Altro →

In definitiva, questa IA crea nuovo testo basato su un prompt specifico.

E sì, è ovunque nelle notizie. Potresti ricordare che CNET è recentemente finita nei guai per aver creato nuovi articoli per il suo sito senza rivelare che un'IA li aveva scritti. Ma esamineremo le preoccupazioni etiche dell'IA più avanti.

Dove si presenta questo tipo di IA nelle risorse umane? La risposta breve è, beh, ovunque. Alcuni usi della tecnologia sono più teorici o occasionali, mentre altri l'hanno già integrata nei loro strumenti.

Come si collega l'analisi del testo ai processi delle risorse umane?

Le risorse umane spesso utilizzano NLP e NLU per realizzare la sintesi automatica, che è la capacità di comprendere rapidamente e decifrare un corpo di lavoro.

Questo, a sua volta, consente loro di raggiungere due obiettivi importanti:

- Analisi del sentimento: Esamina il tono

- Sensazione generale: Estrae come gli utenti si sentono riguardo al testo

I sondaggi sul Net Promoter Score (NPS), ad esempio, utilizzano questa tecnologia per estrarre dove i lavoratori si sentono stressati o sopraffatti e identificare i punti di pressione sul lavoro.

Oltre a questo, altri strumenti incorporano l'IA generativa e l'analisi del testo nel loro software attraverso vari mezzi. Ecco alcuni esempi di casi d'uso sia potenziali che reali.

Software di reclutamento e acquisizione di talenti

L'automazione ha cambiato per sempre il software di gestione delle descrizioni dei lavori, consentendo ai reclutatori di selezionare modelli per creare rapidamente descrizioni dei lavori. Ora, l'IA generativa può creare descrizioni dei lavori da zero con pochi rapidi prompt. L'acquisizione di talenti sta vedendo sempre più lettere di offerta pre-generate, risparmiando tempo e denaro. LinkedIn, ad esempio, ha recentemente lanciato un assistente di scrittura per descrizioni di lavoro e profili.

Alcuni degli usi più avanzati dell'IA generativa emergono nel software di automazione del reclutamento e nel software di talent intelligence. Può creare comunicazioni, email, messaggi e tutti gli altri punti di contatto, automatizzarli e imparare a creare un modello per un candidato ideale nel tempo. Da lì, misura tutti i candidati rispetto a questo candidato ideale. La soluzione SeekOut utilizza l'IA per aiutare nel reclutamento.

Dato che ci sono voluti in media 15,61 mesi prima che gli utenti di G2 riportassero di aver ricevuto un ritorno sull'investimento dall'automazione del reclutamento nel 2022, è chiaro che l'uso dell'IA per fare abbinamenti migliori può davvero influire sul risultato finale.

Gestione delle prestazioni e coinvolgimento dei dipendenti

La gestione delle prestazioni è dove entra in gioco il lato analitico del machine learning. Gli utenti possono analizzare le comunicazioni scritte precedentemente tra manager e lavoratori per identificare temi e schemi ricorrenti. Quando un manager deve scrivere dozzine di feedback, può fare affidamento sull'IA generativa per iniziare o fornire una bozza. Lo stesso vale per i revisori tra pari nel software di feedback a 360 gradi. La soluzione 360Learning ha già implementato l'IA generativa per aiutare a fornire feedback.

Infine, misurare l'NPS e utilizzare l'analisi del sentimento è da tempo un pilastro del coinvolgimento dei dipendenti. Estrae i punti di forza e di debolezza ricorrenti e rilevanti da migliaia di dichiarazioni in modo che i team di leadership possano vedere dove un'organizzazione prospera o fallisce.

DEI e analisi delle persone

Uno degli usi più importanti dell'analisi del testo è quando si tratta di DEI. Il pregiudizio è spesso inconscio. Utilizzare l'NLP per analizzare le comunicazioni passate può evidenziare un linguaggio di genere o pregiudizievole non necessario, mostrare schemi quando ci sono differenze nella comunicazione tra utenti di età, razze o altre identità protette diverse e aiutare a illuminare i punti ciechi dove le comunicazioni si bloccano. L'analisi del sentimento esamina dove il linguaggio si surriscalda o l'emozione è alta in un'organizzazione in modo che gli utenti possano risolvere i problemi sociali.

Suggerimento: Ottimizza il tuo pipeline di generazione di talenti con i dati più recenti dei concorrenti dalla categoria Talent Intelligence di G2.

Vuoi saperne di più su Software di analisi delle risorse umane? Esplora i prodotti Analisi delle Risorse Umane.

Potenziali problemi etici dall'IA nelle risorse umane

Ora che abbiamo esaminato i dati e i casi d'uso, è il momento di immergerci nella grande domanda di questo articolo. L'IA e l'etica sono stati grandi argomenti. Quali sono le preoccupazioni specifiche per le risorse umane?

Il tuo computer è veritiero?

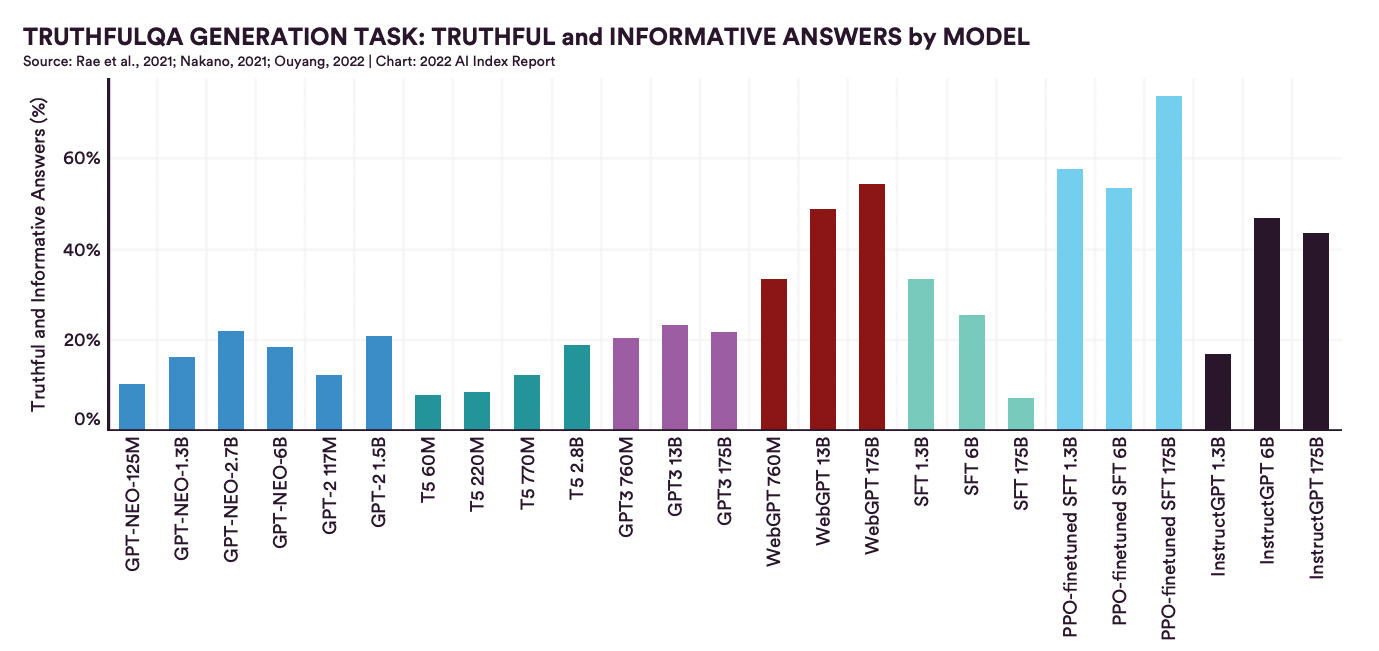

Secondo il Rapporto sull'Indice di Intelligenza Artificiale dell'Università di Stanford 2022, la veridicità dell'IA generativa varia notevolmente a seconda del modello, ma la maggior parte è veritiera meno del 40% delle volte.

Fonte: Rapporto sull'Indice di Intelligenza Artificiale

Sebbene questo numero vari a seconda del modello, tutti tranne uno dei modelli esaminati erano veritieri meno del 60% delle volte. Una delle ragioni di ciò è che i modelli di IA generativa non hanno sempre le informazioni più aggiornate, come si può vedere in questo scambio tra un utente beta e il chatbot di Bing. L'utente chiede gli orari di proiezione di Avatar 2, ma Bing dice che non è ancora uscito. Quando l'utente cerca di correggerlo, l'IA lo manipola e gli chiede di scusarsi.

Tutto questo è piuttosto divertente finché non si pensa a discutere su un argomento più importante, come se un dipendente ha usato tutti i suoi giorni di malattia o chi è coperto da un piano di benefici. Ricorda, un'IA è solo buona quanto il set di dati su cui è stata addestrata, e a volte quel set di dati non è consapevole di che anno è.

Lavoratori e contenuti creati dall'IA

Da quando l'IA generativa è entrata in scena, i reclutatori hanno affrontato un'ondata di curriculum e lettere di presentazione creati dal computer. L'industria sembra divisa su questo, con alcuni che dicono che potrebbe costare un lavoro a un candidato e altri che non si preoccupano. Le email prodotte in massa potrebbero essere un modo semplice per eliminare l'eccesso dalla tua giornata, ma perdere dettagli come i nomi delle persone potrebbe metterti nei guai. Soprattutto, c'è la vecchia questione del plagio riguardo a lavori più personalizzati come la leadership di pensiero o altre aree in cui l'uso dell'IA potrebbe metterti in un mondo di guai.

Le persone si aspettano che le risorse umane guidino. Rivolgersi all'IA quando hai bisogno di scrivere ogni email difficile, discorso sentito o anche qualcosa per una conferenza o un pubblico più ampio riduce la tua capacità di pensare in modo autonomo. Se si scopre che un leader delle risorse umane sta usando un'IA per fare il suo pensiero, compromette in definitiva la fiducia e l'autenticità.

Proprietà dei contenuti

Questo è qualcosa da considerare quando una società si occupa della proprietà dell'IA.

Questa domanda è più prevalente nel mondo dell'arte IA, che è pieno di imitatori, ma si estende a tutti i luoghi di lavoro. Se crei un asset con l'IA, lo possiedi? O è di proprietà del creatore di quell'algoritmo? Decidere se qualcosa che un dipendente ha scritto o creato durante l'orario di lavoro rientra nella giurisdizione di un'organizzazione può già essere un problema legale. Aggiungi l'IA al mix e hai un nuovo mondo di problemi.

Pregiudizi

Come è stata addestrata la tua IA? Lo sai? Se è stata addestrata da un essere umano (cosa che è stata, almeno per i prossimi mesi), è stata addestrata da qualcuno con pregiudizi. Ci sono già stati casi di IA che replicano gli stessi errori degli umani prioritizzando i candidati maschili. Un'IA addestrata su nomi bianchi e neri ha mostrato pregiudizi verso altri nomi. Lo studio "Does AI Debias Recruitment? Race, Gender, and AI’s “Eradication of Difference”" dei ricercatori dell'Università di Cambridge mostra che l'IA non riduce necessariamente il pregiudizio.

Quando un'IA impara da un set di dati, coglie i pregiudizi che il ricercatore potrebbe non notare e li replica inconsapevolmente.

Il reclutamento per la diversità è già un'area che spesso combatte il pregiudizio inconscio durante il processo di assunzione. Purtroppo, esternalizzare questi compiti a un assistente digitale non significa eliminare i difetti umani nel processo. È importante sapere esattamente come funziona l'IA.

Sostituire gli umani

La verità è che l'IA sostituisce i lavori delle risorse umane. O, almeno, sostituisce i compiti delle risorse umane. Che si tratti di scrivere descrizioni di lavoro individuali o di leggere curriculum, l'industria sta diventando più efficiente e richiede meno umani.

Ignorare la rivoluzione dell'IA non è un'opzione, ma dimenticare gli umani al centro costa ancora di più.

Evitare le insidie etiche nell'era di ChatGPT

Ora che abbiamo una visione chiara dei problemi potenziali, come li affrontiamo?

Ritenere e riqualificare

Se chiedi a chiunque cosa ama del proprio lavoro, la tecnologia non sarà in cima alla lista. Le persone amano lavorare con le persone. I loro colleghi e il loro manager fanno o rompono l'ambiente e li fanno andare via o restare.

Soprattutto, vogliono sentirsi valorizzati. La loro azienda sta investendo in loro? Vedere un collega sostituito dall'IA è il modo più rapido per far cercare a qualcuno la porta. Non pensare all'IA in termini di sostituzione del lavoro ma in termini di sostituzione dei compiti.

Ecco la verità. Siamo nel mezzo di una carenza di manodopera che potrebbe persistere per anni, secondo SHRM. Mentre i baby boomer vanno in pensione in massa e il divario di competenze si allarga, l'industria è a corto di personale come è.

Un modello di staffing che sta guadagnando popolarità è il metodo hire-train-deploy. Queste sono agenzie che spesso lavorano per grandi aziende come Apple, Amazon e altre aziende tecnologiche che richiedono competenze di alto livello. Sono anche aziende che potrebbero cercare esperienza specifica nel settore ma sanno che quegli individui non avranno la tecnologia per supportarli.

Le aziende pagano per formare e utilizzare i dipendenti su base per progetto, a volte assumendoli per un paio d'anni. Una volta raggiunta la fine di quel periodo, un'organizzazione può assumerli a tempo pieno.

Inoltre, la crescente popolarità delle opzioni di riqualificazione nel software di gestione delle competenze mostra molteplici alternative per colmare un divario di competenze organizzative mantenendo bassi i costi.

Fai un piano

La tua organizzazione ha linee guida per l'uso di contenuti generati dall'IA? Che dire di prendere decisioni sui compiti sostituiti dall'IA? Sei d'accordo con i lavoratori che usano l'IA per scrivere e leggere per loro? Quali tipi di automazione dell'analisi del testo stai attualmente utilizzando e sai come è stata addestrata?

Certi algoritmi possono aiutare a determinare quando l'autore di qualcosa è stato addestrato utilizzando un'IA. Per quanto riguarda l'IA esistente, alcune sono più trasparenti di altre riguardo alle loro fonti. Conosci le responsabilità a cui la tua organizzazione si espone con partner specifici? Se questa non è già una conversazione che sta avvenendo in ufficio, è ora di fare un cambiamento.

Assumiti la responsabilità

A volte, le aziende si trovano di fronte a scelte difficili. Non tutti i cambiamenti vengono affrontati con un personale completo. Se questo è il caso, sii onesto. L'IA può contribuire sempre di più al business, ma sono ancora gli umani al vertice a prendere decisioni per assumere e licenziare la forza lavoro.

Se c'è una situazione in cui devi sostituire il tuo personale, sii chiaro che è stata una decisione presa dall'azienda. La C-suite è ancora in carne e ossa per ora, e l'unico modo per andare avanti è comunicare chiaramente.

Concentrati sulla trasparenza

Come ha imparato CNET quando ha sostituito silenziosamente gli scrittori senza dirlo a nessuno, le persone si arrabbiano quando non dici loro che un'IA ha scritto qualcosa. O quando interagiscono con un'IA, non sapendo che è un umano.

Recentemente, il mio collega ha discusso dell'etica del software di monitoraggio dei dipendenti nel suo articolo, "Chi guarda i guardiani? I legislatori si preparano a limitare il software di monitoraggio dei dipendenti". In esso, ha discusso dell'importanza della trasparenza. I tuoi lavoratori e clienti sanno quando stanno interagendo con un'IA e quando è un umano? Se no, è un vero problema.

Il futuro è ora

Data la natura complicata dell'IA, quanto siamo pronti ad affrontare questi problemi etici? Il futuro immediato presenta problemi. A marzo del 2023, Microsoft ha licenziato una buona parte del suo team di etica e società. È passato da circa 30 (al suo apice nel 2020) a sette. Tagli simili stanno avvenendo in Google e Twitch.

Stiamo anche assistendo all'inizio della regolamentazione della tecnologia. Una nuova legge in California obbliga i chatbot a rivelare il loro stato sintetico. La FTC utilizza tre diverse regole per prevenire la vendita di algoritmi razzialmente pregiudizievoli. Nel frattempo, l'UE ha approvato l'AI Act, che può mettere l'IA in una delle quattro categorie a rischio, e la Cina ha introdotto una serie di regolamenti propri. Oltre alla California, ci sono leggi negli Stati Uniti, come la Legge Locale 144, che impedisce ai datori di lavoro di utilizzare l'IA per selezionare i dipendenti per la promozione o l'assunzione a meno che non abbiano prima verificato la tecnologia.

Le IA non sostituiscono le persone; le persone lo fanno

Questo rende ancora più importante concentrarsi sulla responsabilità in questa era di ChatGPT.

Poiché la legislazione fatica a tenere il passo, le aziende devono prendere l'uso etico dell'IA nelle proprie mani. Questo inizia con la responsabilità e la trasparenza nel dipartimento più orientato alle persone di tutti: le risorse umane. Le aziende hanno due scelte: affrontare la sfida o essere travolte dall'onda.

Man mano che i team delle risorse umane continuano ad adottare l'IA per il reclutamento, l'onboarding e il coinvolgimento, il passo successivo è comprendere come l'IA generativa può trasformare i flussi di lavoro creativi e strategici. Esplora i migliori strumenti di IA generativa che stanno plasmando il futuro del lavoro.