¿Sabes cómo las redes neuronales convolucionales detectan patrones en grandes conjuntos de datos? El secreto está en el pooling.

El pooling disminuye la complejidad de los modelos de aprendizaje profundo al reducir el tamaño de entrada mientras preserva características esenciales y relaciones entre los datos. Esta operación también se conoce como downsampling o subsampling.

Las redes neuronales convolucionales (CNNs), un tipo de red neuronal artificial, típicamente utilizan operaciones de pooling para el reconocimiento y procesamiento de imágenes. Con CNN, no es necesario extraer manualmente características de los datos visuales. En su lugar, estas redes aplican filtros de diferentes tamaños sobre la imagen para aprender sobre sus características mientras aseguran la variancia de traslación. Esto significa que incluso si el objeto se mueve a una ubicación diferente en una imagen, será reconocido como el mismo objeto.

Estas redes neuronales convolucionales tienen tres capas fundamentales: convolucional, de pooling y capas densas completamente conectadas. La capa convolucional crea un mapa de características a través de filtros que ayudan a reconocer patrones.

La última, una capa densa completamente conectada, ayuda a clasificar en las etapas finales de una red neuronal.

¿Qué son las capas de pooling?

Las capas de pooling en redes neuronales convolucionales reducen las dimensiones de los mapas de características, haciendo que una red funcione más rápido. Estas capas ayudan a la red a identificar las partes más importantes de la imagen, facilitando el reconocimiento de patrones.

Las capas de pooling también evitan que una red se sobreajuste, una causa de aprender detalles irrelevantes. Esto aumenta la velocidad de la red en el procesamiento de imágenes y hace que sea menos probable que cometa errores.

A pesar de reducir las dimensiones, las capas de pooling retienen características esenciales necesarias para la clasificación. Esto permite a las CNNs manejar imágenes grandes y arquitecturas profundas de manera más efectiva.

¿Cómo funcionan las capas de pooling?

Las capas de pooling hacen que las CNN sean más rápidas y eficientes. Estas capas utilizan una ventana deslizante (2x2 o 3x3) para moverse a través de una imagen en pasos. La operación se lleva a cabo en cada paso según el tipo de pooling empleado. Por ejemplo, si se elige el pooling máximo, se toma el valor más grande en la ventana. Este valor más grande representa la característica más esencial de la imagen.

Supongamos que la entrada es una imagen de tres perros. El valor más grande aquí correspondería a la cara del perro. Por otro lado, si se elige el pooling promedio, dará una visión general de las características de la imagen, como el patrón o la estructura de un perro.

La operación de pooling crea una representación reducida de los datos de entrada. Como resultado, la imagen se vuelve más pequeña y más accesible para procesar, aumentando la velocidad computacional.

Puedes aplicar capas de pooling múltiples veces en modelos de aprendizaje profundo, reduciendo progresivamente las dimensiones espaciales de los mapas de características. Esto permite a la red manejar imágenes grandes y arquitecturas profundas de manera más efectiva.

Mientras que el pooling refina las salidas, el aprendizaje en sí comienza antes. Aprende cómo la retropropagación impulsa el entrenamiento de redes neuronales.

¿Quieres aprender más sobre Software de Redes Neuronales Artificiales? Explora los productos de Red neuronal artificial.

¿Por qué son importantes las capas de pooling?

Cuando las capas convolucionales producen un mapa de características, es dependiente de la ubicación. Esto significa que un objeto sería irreconocible si se mueve a una ubicación diferente. La capa de pooling ofrece invariancia traslacional, asegurando que incluso si un objeto en una imagen se traslada, la red neuronal convolucional aún pueda reconocerlo.

Las capas de pooling existen por encima de la capa convolucional, donde reducen la salida de la capa de convolución a través de filtros de varias dimensiones. Normalmente, se utilizan capas de pooling máximo o promedio, pero hay varios otros tipos de capas de pooling utilizadas en las CNNs dependiendo del caso de uso.

Tipos de capas de pooling

Existen diferentes tipos de pooling, como el máximo, promedio, global o pooling estocástico. Profundiza para entender sus beneficios y cómo se diferencian.

Pooling máximo

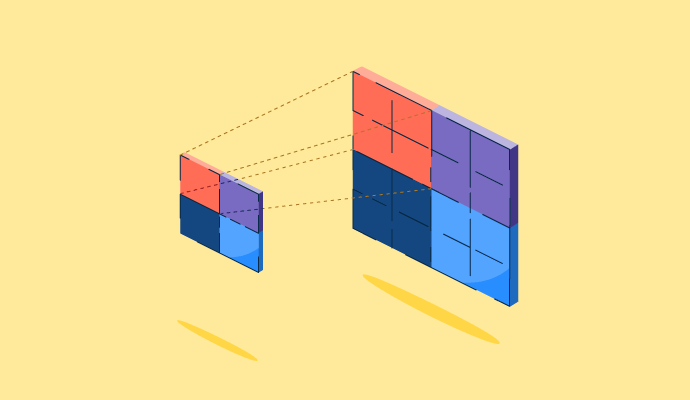

El pooling máximo es el método de pooling más común. Divide el mapa de características de entrada en regiones más pequeñas, llamadas ventanas de pooling o campos receptivos. Estas son típicamente de tamaño 2x2 o 3x3. En cada ventana de pooling, ocurre una operación de agregación, donde se selecciona el valor máximo en la cuadrícula 2x2.

El valor máximo corresponde a la característica más significativa dentro de cada región de la imagen, facilitando al sistema la identificación de patrones clave.

A continuación se muestra el proceso de pooling máximo.

- Crea ventanas de pooling. El mapa de características se divide en regiones no superpuestas de tamaños 2x2 o 3x3.

- Elige el valor máximo. El pooling máximo elige el valor más alto para cada región.

- Produce un mapa de características agrupado. Usando el valor más alto de cada región, crea un mapa de características agrupado. Este tendrá dimensiones menores que el mapa de características convolucionado.

A medida que se reduce el tamaño del mapa de características, también se reduce la potencia computacional requerida para procesar la imagen. Este tipo de pooling captura las características más importantes y descarta los detalles irrelevantes. Hace que la red sea más robusta a pequeños desplazamientos o traslaciones en una imagen.

Pooling promedio

El pooling promedio funciona igual que el pooling máximo, pero en lugar de seleccionar el valor máximo, toma el valor medio de cada región. Al considerar todos los valores en una región, el pooling promedio retiene más información sobre las características.

Así es como funciona el pooling promedio:

- Divide el mapa de características. El mapa de características se divide en regiones no superpuestas.

- Calcula el valor medio. El pooling promedio calcula la media de todos los valores en un área.

- Desarrolla un mapa de características agrupado. Estos valores medios conforman el mapa de características agrupado. El mapa de características agrupado producido por el pooling promedio es más suave y menos ruidoso que el producido por el pooling máximo.

Pooling global

El pooling global se aplica sobre todo el mapa de características y da un solo valor para cada mapa de características. Este tipo de capa de pooling funciona en las etapas finales de las redes neuronales convolucionales, donde el mapa de características se convierte en un vector de tamaño fijo antes de ser pasado a las capas completamente conectadas.

El pooling global también incluye métodos de pooling máximo y promedio. El pooling máximo global utiliza el valor máximo de todo el mapa de características, mientras que el pooling promedio global toma el valor medio en su lugar. Ofrece un tamaño de salida fijo independientemente del tamaño de la entrada, lo que facilita la conexión a capas densas completamente conectadas.

Pooling estocástico

El pooling estocástico introduce aleatoriedad en el proceso de pooling. Elige valores basados en la distribución de probabilidad derivada de diferentes valores en la región de pooling. Aquí, no seleccionas un valor máximo o promedio de diferentes áreas en el mapa de características.

Fuente: Citeseerx

La aleatoriedad evita que la red se sobreajuste a los datos de entrenamiento. Esto lleva a una mejor generalización, permitiendo que la red explore diferentes representaciones de características.

Beneficios y desafíos de las capas de pooling

Las capas de pooling preservan las características más críticas de los datos de entrada al ofrecer invariancia de traslación. Esto permite al modelo generar la misma salida independientemente de cambios menores en la entrada.

Estas capas son cruciales en el tamaño y la complejidad de los modelos de aprendizaje automático, haciéndolas útiles en varias tareas de aprendizaje automático. Se colocan después de las capas convolucionales en una CNN, donde reducen la salida, ayudando al modelo a procesarla más rápido. Estas capas también ayudan a seleccionar las características más importantes de una imagen utilizando la técnica de pooling máximo.

Aunque la capa de pooling reduce las dimensiones de una capa de entrada, también contribuye a cierta pérdida de información de los mapas de características. Existe la posibilidad de suavizar en exceso los mapas de características que podrían llevar a una pérdida de detalles cruciales para la tarea de regresión final.

Además, entran en juego hiperparámetros como las regiones de pooling y el tamaño del stride. El stride evalúa cuántos cuadrados o píxeles saltan los filtros al moverse a través de una imagen de izquierda a derecha o de arriba a abajo. Necesitas ajustarlos para lograr un rendimiento óptimo, lo que puede ser un proceso que consume tiempo y requiere una experiencia razonable en el modelo.

Haciendo las CNNs más rápidas

Las capas de pooling hacen que las redes neuronales sean más robustas contra distorsiones en los datos de entrada. También mejoran el rendimiento del modelo en nuevos datos no vistos al reducir su tamaño y evitar que se ajuste demasiado a los datos de entrenamiento.

En general, hacen que las redes neuronales convolucionales sean más rápidas al simplificar los datos mientras mantienen información importante.

Aprende sobre redes neuronales recurrentes y entiende cómo facilitan el reconocimiento de voz y la generación de subtítulos para imágenes.

Editado por Monishka Agrawal

Sagar Joshi

Sagar Joshi is a former content marketing specialist at G2 in India. He is an engineer with a keen interest in data analytics and cybersecurity. He writes about topics related to them. You can find him reading books, learning a new language, or playing pool in his free time.